- +1

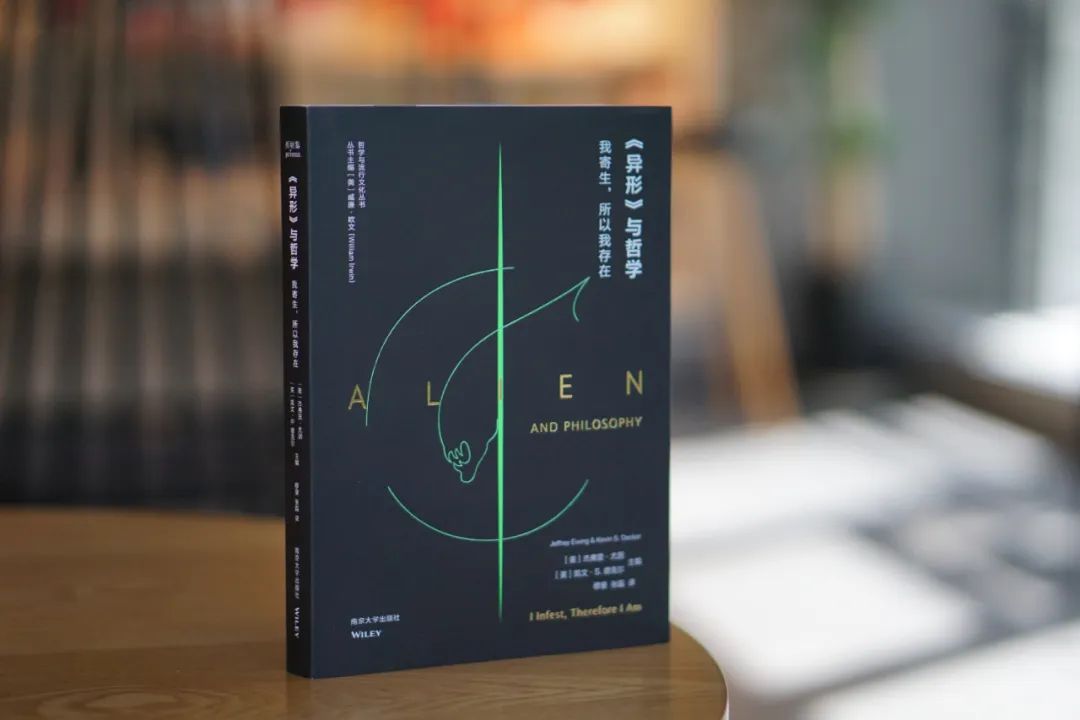

《异形》与哲学:我寄生,所以我存在

编者按:

编者按:宇宙深处埋藏着人类的未知和恐惧,正在院线热映的《异形:夺命舰》再次将我们带入了一场惊心动魄的生存之战。但在这场视觉盛宴的背后,你是否曾思考过那些非人类生命形态——尤其是仿生人,他们的存在究竟意味着什么?

随着人工智能技术的飞速发展,仿生人(或更广义上的人工智能)的伦理问题正日益凸显。《异形:夺命舰》不仅是一部科幻惊悚片,更是对未来社会的一次深刻预演。它迫使我们思考:当技术发展到足以创造出具有自我意识与情感的机器时,我们应当如何对待它们?是继续将它们视为工具,还是赋予它们与人类同等的道德地位?

在这个充满挑战与机遇的时代,让我们带着对未知的敬畏与对生命的尊重,一同探索仿生人背后的哲学奥秘。正如《〈异形〉与哲学:我寄生,所以我存在》所揭示的那样,每一个生命形态的存在都有其独特的意义与价值。

仿生人:人造人格,还是高级烤面包机?

乔·斯雷特

你有道德地位。这么说的意思是,你是重要的。比如说,世界上有一些事,是你不应该去做的;还有一些事,是我不应该对你做的。你有权利。那么,是什么赋予了你这样的道德地位?是生而为人的身份吗?《异形》里诺斯特罗莫号船员发现的那种生物,也有道德地位吗?它会被错误地对待吗?你或许会认为,尽管我们有充分的理由憎恨这些生物,且我们决不愿与它们接近,但对它们施虐仍是错的。那么合成人呢?《异形》里阿什那样的仿生人也拥有权利吗?面对这类问题,哲学家已经尝试过用多种方式回答。本章将会探讨其中的几种,同时思考一些很难解释的情况——其困难程度可能出乎你的意料——比如婴儿为何关系重大,动物是否有道德地位,以及在道德层面上,我们应当如何看待合成人(或者按毕肖普喜欢的方式来称呼——“人造人格”)。

“保护人类已经写进了他的程序”

我们可以试着这样回答上述问题:只有人类才有道德地位。这是个漂亮而简洁的答案。由于这条用于评判道德地位的规则不取决于智力和能力,于是我们可以宣布,即使是人类婴儿(谁都知道婴儿不怎么聪明!)也具有道德上的重要性。这样解释很好,因为通常来说,我们确实认为不应该随便殴打婴儿。

不过,如此思考可能带来一些我们并不乐见的后果。如果身为“人类”的关键仅仅在于基因编码,那么似乎应该认为,与完全发育的成人相比,人类胚胎有着同等的地位。同理,完全脑死亡但仍然活着的人类,也应当被给予道德考量。确实,很多人认为胚胎和处于持续性植物状态的人也拥有一些权利,但他们的地位是否等同于正常成人,则仍是一个有争议的问题。

我们也许可以考虑一下另一类问题案例,这类案例涉及人类范畴的划分。比如,《异形4》中的考尔注意到,起死回生后的雷普利并非人类。考尔向众人解释,“伦克隆了她,因为她体内有一只异形。”这位克隆雷普利似乎是一个混合体——大部分是人,少部分是异形。如果说,克隆雷普利由于与人类极其相似,因而也拥有道德地位,那么要多相似才算“极其相似”?《异形4》片尾出生的那只异形同样拥有部分人类的DNA,也将雷普利认作它的母亲,它也能归属于我们的道德共同体之内吗?

胚胎、脑死亡者和人类异形混合体这三个案例,也许能让我们反思:真的只有人类才重要吗?还有一些被这一公式排除在外的其他事物,也应当被给予道德考量,比如动物。不论我们是否饲养宠物或者吃素,我们都很可能被某些动物影响我们的决策。在《异形》里,雷普利为了拯救小猫琼斯大费周章。这一定是因为她认为——不知为何——琼斯很重要,而如果琼西死掉,那将会很糟糕。

《〈异形〉与哲学:我寄生,所以我存在》

《〈异形〉与哲学:我寄生,所以我存在》澳大利亚哲学家彼得·辛格提出,只有人类才配拥有道德地位的想法,是物种歧视。他认为,物种歧视和种族歧视、性别歧视一样,在道德上是可憎的。尽管大部分西方人已经承认种族歧视和性别歧视很糟糕,然而,辛格认为,我们尚未正确理解其他物种的道德地位。宣称人类仅仅因为其身为人类所以特殊,这种观点很难说有什么合理性;这似乎完全是武断的。物种歧视的指控试图将潜藏在我们道德思考之下的偏见暴露出来,并促使我们反思这样一个问题:在考虑是否应当将某种行为施加给某人(或某物)时,哪些事实是要紧的。我们可以想象出拥有某些道德权利的某种有智慧的动物或外星物种——甚至包括《异形》系列里的那些——或者人工合成的生命形态。因此,仅凭是否属于人类来划定界限,似乎很难站得住脚。

自主性

赋予某事物道德重要性的,也许并非简单的物种归属,而是某种特殊的能力或特性。那么,我们就可以宣布,禁止对任何具备那种特性或能力的事物施加某些特定的行为。这样一来,动物、外星人或仿生人就被划入了有道德地位的一类。包括伊曼努尔·康德在内的一些哲学家认为,在判断能否赋予某事物道德地位时,自主性是一种好用的标准。自主性本身很难定义,但我们暂时可以将其理解为一种分辨优劣、权衡利弊,并自由地选择依照这些选择做出行为的能力。

康德认为,自主性决定了道德地位,因为他认为,唯一本身为善(而非仅作为手段去达成其他善的目的时表现为善)的东西是善良意志。我们可以将这个概念理解为善良的意图。康德称,如果你能制定道德律令并自觉遵守,那么你就是在依道德行事,而这么做的前提是你拥有自主性。我们可以把自主性视为衡量道德地位的至高标准的原因之一是在确定其他道德概念的含义时,自主性起到了作用。例如,自主性的拥趸提出,除非你自己是自主的,否则你不会认为其他道德主体有内在价值。照此理解,我们不需要知道《异形4》里的克隆人雷普利8号是否属于人类,以判断她是否在道德上是重要的。如果她能考虑未来的各种情况,并做出正确的选择,那么她就是重要的。合成人和“人造人格”也是同理。假如毕肖普有自主性(只是举例),那么,作为道德主体的我们将他仅仅当作工具来使用,就是错误的行为。

但这种解释似乎也有问题。依靠自主性进行解释,不仅将普通的、非自主的动物排除在了道德考量之外,也落下了婴儿。婴儿做事时并不会仔细考虑各种选项,也不会选择要遵守的规则。认可自主性为终极道德准则的人提出,如果将禁止对具备自主性的道德主体施加的那些行为,施加给婴儿或动物,这在本质上并没有错。相反,他们说,伤害婴儿或动物有错的原因,在于这种行为对我们这些道德主体会造成影响。随便虐待婴儿是错的,因为这对他们的父母而言是糟糕的,或者因为这会让我们变得凶残,因而更容易忽视或违反道德律令。

另一种能让婴儿保留其道德地位的方法,是把任何有可能获得自主性的事物都视作具有道德地位。虽然这么做不会落下婴儿,但这就迫使我们认为胚胎——也许还包括单个的精子和卵子——有道德地位,因为这些事物似乎都有可能成为具有自主性的实体。也许更成问题的是,这样的观点无法解释为何动物是重要的。你不必是一个素食主义者就能认识到不应该随意虐待动物。通常来说,我们所有人都认为动物占据某种道德上的位置。《异形》中雷普利拯救小猫琼斯不无理由。(其实我认为,冒着巨大的生命危险救猫,有些冒险过头了。拜托,艾伦,不过是只小猫而已!)类似的,当《异形3》中墨菲的狗斯派克死掉时,他为此伤心落泪也并非完全不可思议。因而,如果一种道德理论无力解释动物的生命和苦难为何有意义,那么这似乎确实是很严重的缺点。

“因为疼痛会让你痛苦”

另一种用以评判道德地位有无的显而易见的标准,将重点放在了对痛苦和快乐的感受上。在古希腊,伊壁鸠鲁的追随者们就持这种观点。后来,杰里米·边沁在概述功利主义在道德上的位置时,曾为上述理论辩护。针对生物为何拥有权利的问题,他问道:

是理性思考能力?或者,也许是交谈能力?然而,完全长大了的马和狗,较之出生才一天、一周甚至一个月的婴儿,在理性程度和交谈能力上强得不可比拟。但假设是别种情况,那又会有什么用?问题并非它们能否作理性思考,亦非它们能否谈话,而是它们能否忍受。

我们大多数人可能都不会觉得这有什么不合理。不应该对小猫琼斯或婴儿——或你或我——施加拳脚,原因在于我们能够体会痛苦,而“疼痛会让你痛苦”——《异形4》中雷普利用这句话提醒约翰纳离她远点。这个原因本身足以阻止我们动手了。

对边沁这样的传统功利主义者而言,痛苦与快乐是唯一关乎道德的东西。所以,任何能够体会痛苦或快乐的事物,都具有道德地位。这样一来,普通成年人类、婴儿和大部分动物就都被干净利落地包括了进来。植物、脑死亡者或胚胎显然被排除在外。而人工合成的实体能否被包括进来,则可能成为一道难题。在《异形》里,仿生人阿什被斩首后没有表现出丝毫痛苦。确实,让合成人有能力感受痛苦有什么意义?应该留意的是,体会痛苦不等同于意识到你遭受了某种伤害。前者是一种你想要尽可能减轻的感觉,而后者只是一种诊断学上的认知。假如你被麻醉了,你能意识到腿断,但感觉不到疼。我们可以把合成人想象成这种情况。

巧合的是,毕肖普似乎确实能感受疼痛。在《异形3》中,当雷普利想办法将毕肖普严重损坏的躯体重新启动时,毕肖普说:“我很疼。帮我个忙,把我关掉。”如果把这句话按字面理解,那么根据边沁描绘的图景,合成人——至少毕肖普这类合成人——确实具有道德地位。这将表明我们对仿生人负有道德义务,但在《异形》宇宙中,这是成问题的。毕竟,毕肖普被人像奴隶一般呼来唤去,而且伯克说:“飞船上必须有一个合成人,这制度已经实行很多年了。”

《异形:夺命舰》剧照

《异形:夺命舰》剧照出于论证的目的,我假定仿生人无法真正感受疼痛。也许毕肖普的话是一种比喻。无论如何,无法体会疼痛的这类合成人——这种类型确实可能存在,阿什可能就是其中之一——提出了一个有趣的问题。类似这样的实体真的在道德上毫不重要吗?

主体和客体

到目前为止,我们仅仅考察了单一类型的道德地位。你不应该遭受某些方式的对待,这说明你有道德地位,尽管如此,我们也许还会认为,道德地位还存在着另外一种重要的形式。一个普通人类既可以受到错误的对待,也可以犯错。其中的差异事关重大。一方面,存在既能道德也能不道德地行动的事物,即他们可以按正确的方式做事,也可以按错误的方式做事。哲学家将他们称为道德主体。另一方面,还有一些事物能承受道德行为,即他们既可以被错误地对待,也可以被正确地对待。这些东西叫作道德客体。

根据这种看法,普通人类既是道德主体也是道德客体,但婴儿并非主体——婴儿做事时所遵照的原则,似乎既不是善也不是恶。然而,似乎存在这样一些行为是我们大多数人认为不应当施加给婴儿的。同样的道理也适用于大多数动物。

我们也许会认为,迄今我们观察过的解答道德地位问题的两种答案——自主性和感受快乐或痛苦的能力——应对的分别是主体性和客体性两种相互独立的道德情形。从道德层面而言,有能力正确或错误地行事的生物,似乎应该能分析潜在的选项并从中选择。如果你无从选择自己的行为,那么你就不能因你所做的事而受指责。假如异形总是纯粹依照本能行事,不评估各种选项而从中任意选择,那么它们似乎就不是道德主体。它们或许更接近于狮子或蛇那样的捕食性动物。对它们的行为方式加以指责并没有太多意义。

至于道德客体性,我们也许可以认为,用感受痛苦或快乐的能力足以解释。对某事物施加某种行为会让它感到痛苦,这个原因似乎足以让你不那么做,与此同时,如果对某些事物施加某些行为会让它们获得快乐,这也可以成为促使你这么做的原因。当然了,认为有时应该让道德客体承受痛苦,可能也没有错。有时,为了安全,你可能不得不从行星环绕的轨道上发射核弹,炸掉遍布异形的殖民地,因为不这么做可能导致更加糟糕的结果。

“那是个机器人!该死的假人!”

那么,这样一来,仿生人又处在什么位置呢?如果我们认定他们无法真正地体验快乐和痛苦,那么他们就不是道德客体。也许他们只是道德主体。合成人好像确实会权衡利弊,在各种情况中做出选择。如果是这样的话,那么他们就可以错误地对待他人,比如阿什就曾欺骗诺斯特罗莫号上的全体船员;但他们无法遭受错误的对待。

《异形:夺命舰》剧照

《异形:夺命舰》剧照这似乎并不完全正确,因为迄今为止,我们讨论的痛苦和快乐都只是肉体上的。比如,被刀刺伤或者被枪射伤的痛苦,或者享受食物或性爱的快乐。就算合成人无法体会这种东西,有什么要紧的吗?人类的许多苦难或愉悦都有非肉体的来源。雷普利在《异形2》中安慰难以入睡的纽特时,纽特显然能够遭受做噩梦的痛苦。然而,正如纽特提醒我们的那样,她的洋娃娃凯西却不会痛苦,因为“她只是一块塑料”。做噩梦并非肉体上的痛苦,但对做噩梦的人来说无

疑是糟糕的。在考虑是否应当将某种行为施加给一个道德客体时,最要紧的正是这一差异——将能够体会好恶爱憎的事物与塑料娃娃这样单纯的物品区别开的差异。

那么,合成人有这种特性吗?他们有希望或梦想、欲望或偏好吗?答案似乎是肯定的。就算毕肖普不能感受痛苦,他仍然似乎具有某种喜好。当他虽不情愿但主动地表示让自己离开相对安全的区域,前去远程操控飞船时,他说:“我宁可不去。虽然我只是个合成人,可我也不蠢。”在《异形3》里,他表达了希望被关机的愿望:“你们可以把我拿去重新加工,但我不可能再次成为尖端产品了。我宁愿什么都不是。”也许这番话意味着他有某种程度的自尊,以及如果他成为尖端产品的愿望不能被满足,那么他宁愿不再存在。就连阿什似乎也有愿望或偏爱,这在他对异形的迷恋中表现得最明显:“异形是完美的机体。构造精巧、诡诈狡猾、终极的暴虐……谁能不倾慕完美之物?”

尽管并非人类的所有欲望都会出现在合成人身上,但这些欲望也是赋予了生命意义的东西之一。功利主义更现代的版本叫作偏好功利主义,它所应对的就是这类问题。偏好功利主义更关心的是实体的喜好。偏好功利主义宣称,我们应当做能够满足最多偏好的事,无论这些偏好是动物的,人类的,还是仿生人的。然而,我们不用采取如此激进的立场;我们可以说,拥有偏好本身,就足以让你成为道德客体。你也许想说,例如,由于喜好的类型不同,或者喜好的对象优劣有别,所以尽管同为道德客体,兰伯特、帕克和雷普利的喜好却比小猫琼斯的喜好更重要。

当我们用如此宽泛的方式来看待喜好时,我们似乎就能对合成人负有道德责任。通常来说,这似乎无关紧要,但如果在并不太远的未来发明出了人工智能(AI),那么这将成为一个亟需思考的议题。考虑到这一点,人工合成的生命形式也可以被看作道德客体。也许到那时,阿什和毕肖普也会和我们一样,被认为既是道德主体,也是道德客体。然而,我们仍然可以质疑仿生人是否能够成为真正的道德主体。考虑到仿生人只是运行在硬件设备上的一段电脑程序,把仿生人看作道德主体可能会很奇怪。正如毕肖普自嘲时所说,他“不过是一台高级烤面包机”。认为你的笔记本电脑上运行的程序应该为它的输出负担道德责任,这似乎非常不可思议。

实际上,对毕肖普的自主性的认定,并非那么清楚。能够真正选择要做的事,对于判断自主性很重要。毕肖普说得很清楚,他体内的程序限制了这种选择。在听闻阿什对诺斯特罗莫号船员的背叛后,他试图解释为何他不会做出同样的行为:“我们体内新装了行为抑制器,这种事情现在不可能发生了。我不可能伤害人类,也不可因行为疏忽允许人类被伤害。”这使他失去了一些选择,可以认为这威胁到了他的自主性。看来,自主性需要自由意志,而使选择受限的牢不可破的规则,则会限制自由意志。

但这与我们真的那么不同吗?人会患上各种心理疾病,妨碍他们做事:令人瘫痪的恐惧症、抑郁症,或者是一些使患者认为某些行为无法想象的病症。这些都可能切实地阻止你做某事,正如毕肖普由于自身的限制,无法做任何伤害人类的事。因此,人造人格和人类之间存在真正的差异,足以影响到他应接受何种对待吗?难点之一在于辨认出一个机体何时能够真正拥有喜好,以及何时能够为未来权衡利弊。很明显,烤面包机是做不到的,然而,除非人类确实存在什么无法被机器复现的特质,否则我们很有可能在未来创造出人造人格。如果我在这里所做的思考正确无误,那么用残忍的方式对待人造人格,或者把他们当作工具或奴隶——如同《异形》和《异形2》中发生的那样——将会是错的。不过,你能指望维兰德汤谷公司不那么做吗?

本文节选自《〈异形〉与哲学:我寄生,所以我存在》

编辑 | 金少帅

摄影 | 王冠蕤 来自网络

原标题:《《异形》与哲学:我寄生,所以我存在》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2026 上海东方报业有限公司