- +1

让马斯克冲上热搜的神秘组织,霍金曾任顾问;关于AI的鸿沟,纽约大学教授发出警告

号外!就在昨天,未来生命研究所又发布了一则联名公开信,直接“叫停”所有超越GPT-4的AI,呼吁暂时“封杀”强人工智能研发。

公开信的署名包括特斯拉CEO马斯克、Stability AI首席执行官Emad Mostaque、苹果联合创始人Steve Wozniak、纽约大学教授马库斯……截至目前,已有超过一千人署名附议。

生命未来研究所的这封信中写到,“人工智能的研究和开发应该重新聚焦于优化最先进的系统,让它更加准确、安全、可解释、透明、稳健、一致、值得信赖、对人类忠诚”。

让未来生命研究所有什么来头?和马斯克什么关系?

为要创造可信的AI?如何创造可信的AI?

接着往下读,这两个谜底,你都能搞明白。

揭秘[未来生命研究所]

01

一场影响人类未来的大会,和一个组织

在2015年第一个星期天的下午,一群人悄然集结参加一场在波多黎各某度假胜地举办的闭门会议。

这场会议,汇集了牛津大学人工智能伦理学家尼克·博斯特伦、Skype的创始人扬·塔里安以及Google的AI专家肖恩·莱格。会议有着非常乐观的主题:“AI的未来:机遇与挑战并存”,而让这场大会显得更加神秘的是,一切媒体记者被禁止参加,同时参会者在参会期间也不能私下公开看法。

波多黎各大会参会者合影

在长达一周的会议即将落幕的傍晚时分,所有人准备走向酒吧,参加随后的庆祝聚会。而大会的主办人泰格马克教授,却让大家再留步片刻,“有个大事情要宣布”。随后,一个健硕的身影走到台前,他就是埃隆·马斯克。灯光下,马斯克的出现让台下爆发一阵骚动。

马斯克清了清喉咙,开始宣布,要将1000万美元捐赠给这个MIT教授创立仅一年的组织——未来生命研究所(Future of Life Institute的英文缩写,简称FLI)。

02

未来生命研究所诞生记

马斯克是在最后几分钟才赶到庆典现场。两天后,SpaceX就要进行一次重要的火箭发射,尝试在海面平台回收部分火箭。但他还是坚持赶到了现场,因为他相信,这场大会和这个新诞生的组织,对世界有着非同寻常的意义。

在很多媒体的报道中,经常是这样描述埃隆·马斯克——一个坚定的人工智能威胁论者。起因是他在2014年8月发布的那条人尽皆知的推特:“我们需要对AI保持谨慎。它们可能比核武器还要危险。”

未来生命研究所作为一家非盈利组织,

链接学术界与科技企业界,推动“AI有益运动”的发展

也几乎是与此同时,一位MIT的教授也在这样的信念下,推动着自己的计划。因为马斯克那条有些“危言耸听”的推特,两人的故事发生了交集。几乎是一拍即合,在他们第一次电话联络的时候,马斯克便同意加入未来生命研究所的科学顾问委员会,并表示愿意资助未来生命研究所筹备开篇提到的波多黎各大会。

那这个未来生命研究所究竟是在什么样的情况下诞生的呢?

成立之后究竟为了推进什么研究呢?

03

疯狂迈克斯

在成立未来生命研究所之前,作为MIT物理学终身教授,泰格马克已经在平行宇宙方面的研究上成果斐然。他师承约翰·惠勒,与理查德·费曼和基普·索恩师出同门。数理宇宙的假说让他成为“当今最具原创力的科学家”。

这些年里,泰格马克将研究领域扩展到了人工智能。不少人会觉得诧异,一个物理学家,为什么要“开小差”,跑去研究人工智能?

《生命3.0》作者:泰格马克

一方面,MIT在人工智能领域积淀深厚。虽然人工智能在达特茅斯学院最先提出,但最初实现的却是麻省理工学院。另一方面,泰格马克的很多研究都是基于最新的计算机技术,他自己曾开发数据分析工具,用于宇宙微波背景的研究。过去几年一直与MIT的团队在AI研究领域耕耘,至今已经发表了5篇AI技术领域的论文,其中一篇是与杨立昆(深度学习领域三巨头之一)合作发表。

私下里,他更喜欢大家给他取的外号“疯狂迈克斯。”在科学家的外衣下,他有着一颗梦想家的心。用他的话说,“从我14岁知道了核军备竞赛以来,我一直担心我们的技术力量比我们控制它的智慧增长得更快。”这种担忧一直伴随着他的学术生涯,并让他不断行动起来。也正是这种浪漫主义,让他和埃隆·马斯克和斯蒂芬·霍金走到了一起。

在他的第一本书《穿越平行宇宙》新书巡回之旅中,他决心要为这个世界做些什么。首先,要成立一家非盈利组织,专注于用技术管理来改善未来生命的境况。

04

未来生命研究所与它的成员们

接下来,泰格马克开始勾搭自己的朋友。在伦敦,泰格马克找到了Deepmind的创始人丹尼斯·哈萨比斯。两个人在聊了一圈AI领域的技术突破与变革后,泰格马克向哈萨比斯摊牌,包括自己在AI安全研究方面的想法以及未来生命研究所的计划。哈萨比斯赞同了泰格马克的想法,并将在研究方面给予支持和帮助。

而另一位朋友扬·塔里安(Skype创始人)就更实在了,当泰格马克向他承诺了未来生命研究所的愿景后,便决定每年拨给他10万美元的经费。

在一年后的波多黎各大会上,塔里安半开玩笑说:这是我做过的最好的一笔投资,这对我来说简直意味着整个世界。随后,一批来自高校的志愿者加入到了未来生命研究所中。

委员会中涵盖了AI领域研究者、企业家、科学家乃至哲学家。

详细介绍可参考https://futureoflife.org/team-chinese/

一方面,未来生命研究所通过资助全球各地的研究团队,保证AI安全领域研究的推进。另一方面,通过与世界顶级专家、企业家的定期会议与讨论,推动AI安全研究的社会共识。

而未来生命研究所该机构的科学顾问委员堪称豪华,包括宇宙学家史蒂芬·霍金、SpaceX 和特斯拉汽车创始人埃隆·马斯克、牛津大学未来人类研究院主任尼克·博斯特伦、麻省理工数字商业主任埃里克·布林约尔松、哈佛大学遗传学教授乔治·丘奇、MIT物理学教授阿兰·古斯以及剑桥大学、加州伯克利等大学的人工智能方面的著名教授都参与其中。

05

“AI有益运动”——让AI安全性研究进入主流

2014年,未来生命研究所打响了自己的第一枪。泰格马克与斯图尔特·罗素、史蒂芬·霍金联合在赫芬顿邮报上发表的《超越我们对超级智能机器的自满》一文。表达了作者对迅速发展的AI潜在的风险与隐忧。

那篇经常被其他媒体曲解的“原版”文章:

https://www.huffingtonpost.com/stephen-hawking/artificial-intelligence_b_5174265.html

这篇文章引发媒体对AI安全报道的热潮,伊隆·马斯克、比尔·盖茨等科技领袖纷纷加入讨论,发表各自的观点。遗憾的是,很多媒体搞错了方向,发表《史蒂芬·霍金警告说,机器人的崛起对人类可能造成灾难性破坏》这种危言耸听的文章。

所以真正让AI安全性研究步入主流的,是2015年1月召开的波多黎各大会。也就是刚刚文章开头出现的那一幕,这场大会,几乎所有的参会者都对这个问题产生了共识。

06

这个时代最聪明的头脑集合在一起

在这场大会结束后一周,未来生命研究所便推出AI研究资助金申请通道。全世界大约有300个团队申请,在经过筛选后,37个团队开始了第一阶段的研究。

另外,一封著名的公开信也进入了公众视野。在这封名为《迈向强大和有益人工智能的优先考量研究方案》的公开信中,强调了“研究不应该只限于扩展AI的能力,而是也需要把AI对社会的效益发挥至最高点”,并为下一阶段的研究列出了优先考量的目标。这封公开信很快就收集了8000多个签名,其中包括许多享誉全球的AI开发者以及伊隆·马斯克和斯蒂芬·霍金等人。

也是在此时,媒体对“AI有益运动”报道产生了微妙的变化,再也没有终结者的照片。AI安全性研究终于不再是空谈,而是有许多实际有用的工作要做。并且,许多优秀的研究团队纷纷卷起袖子加入进来。

阿西洛马大会的合影,也是AI有益运动的“群英谱”,你可以在里面找到拉里·佩奇、埃里克•施密特这些企业家,吴恩达、丹米斯·哈萨比斯这样的技术专家,以及丹尼尔·卡尼曼这样的来自心理学、经济学、社会学方面的顶级专家。DeepMind、谷歌、Facebook、苹果、IBM、微软和百度等公司的代表悉数到场。

随后,在2017年阿西洛马大会上,“AI有益运动”被推向了第一个高潮。再想想昨日叫停强人工智能开发的公开信,如果你读到这里,也许丝毫不觉得意外。

如何创造可信的AI?

《如何创造可信的AI》作者:盖瑞·马库斯

新硅谷机器人创业公司Robust.AI首席执行官兼创始人。机器学习公司“几何智能”首席执行官兼创始人,该公司于2016年被优步收购,随后马库斯在优步创立了人工智能实验室。

纽约大学心理学和神经科学教授。研究方向跨越人类和动物的行为,涉及神经科学、心理学、人工智能等多个领域。

1994年于麻省理工学院博士毕业,师从心理学大师史蒂芬·平克。

如何创造可信的AI?与马斯克一起署名的盖瑞·马库斯,就曾写著过直指该问题的同名书籍。

在《如何创造可信的AI》中,马库斯指出:理想与现实之间,存在着一个被称为AI鸿沟(The AI Chasm)的大坑。此大坑可以一分为三,每一个都需要我们坦诚面对。

第一个坑,我们称之为“轻信坑”。从表面上看,机器的行为常常与人类行为有相似之处,于是我们会不假思索地认为机器也拥有和人类一样的某种思想机制,而事实并非如此。

某些东西在某些时刻貌似拥有智慧,并不意味着它的确如此,更不意味着它能像人类处理所有的情况。

第二个坑,我们称之为“虚幻进步坑”。误以为AI解决了简单问题,就相当于在难题上取得了进步。

一句值得记住的格言是:对于一项复杂的技术项目,完成其前90%的工作往往需要花费10%的时间,而完成最后10%则需要花费90%的时间。

第三个坑,就是我们所称的“鲁棒坑”。在业界时常发生:每当AI 解决方案能在某些时候发挥作用,人们就会假定,只要再多一点数据,此系统就能在所有的时刻发挥作用。

在当下的AI 研究中,鲁棒性未得到足够重视。部分源于目前的研究领域的容错率较高,比如广告和商品推荐。但在无人驾驶汽车、老人照护、医疗规划等领域中,鲁棒性都至关重要。没人会花钱买个只能以五分之四的概率将爷爷安全抱到床上的机器人管家。

没人对这类错误做任何解释,但这并不少见。

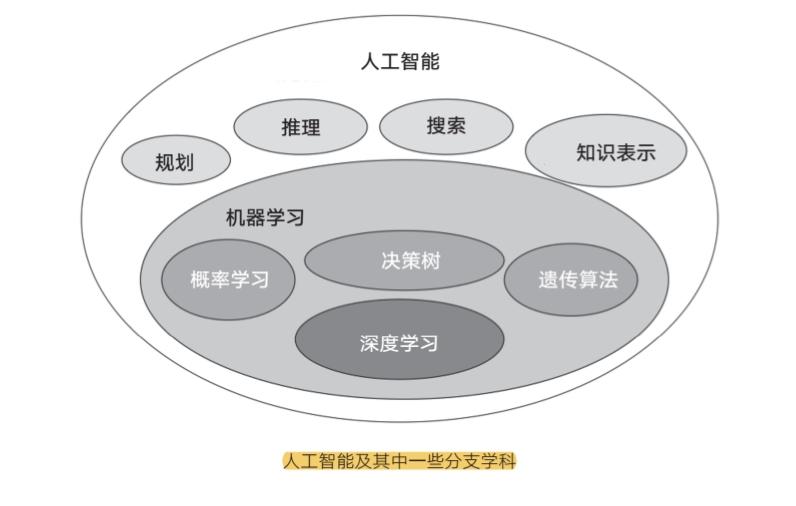

既然存在这么多问题,为什么还有那么多人对深度学习狂热追捧呢?

因为它在处理大规模数据集的统计近似问题时非常有效,而且还能一键解决非常多的问题。同时,深度学习有着很高的商业价值。

有所成就并不意味着深度学习的行为背后存在一个真正的智能。

深度学习是与人类思想有着天壤之别的怪兽。它可以成为拥有神奇感知能力的白痴天才,但几乎不具备综合理解能力。

能语音识别和物体识别的系统充其量不过是智能的片段而已。若想获得真正的智能,还需要推理能力、语言能力和类比能力,没有一个是当前技术所能掌握的,因为系统本身的模式分类能力并不足以完成这项任务。

大众媒体对深度学习的描述和吹捧会令人产生误解。这也让深度学习成了一个“美好”的悲剧。之所以悲剧,是因为无法保证现实世界中的系统正确应对迫切需求,更不能保证在系统犯错时能找出症结,排除故障。从某种角度来看,深度学习更像是一门艺术,而非科学。

如今的现实情况,就好像有人发明了电动螺丝刀,整个社会便立刻觉得星际旅行指日可待。

若想跨越“AI 鸿沟”这个大坑向前走,我们需要做到三件事:搞清楚AI技术的利害关系;想明白当前的系统为什么解决不了问题;找到新策略。

工作机会、人身安全、社会结构,这些都与AI 的发展息息相关。由此可见,所有人都迫切需要紧跟AI行业的最新进展,都需要用批判的眼光去审视AI,区分宣传与实情。就如同昨日那封公开信的最后一句:

让我们享受一个长长的AI之夏,不要毫无准备地冲入秋天。

原标题:《书单 | 让马斯克冲上热搜的神秘组织,霍金曾任顾问;关于AI的鸿沟,纽约大学教授发出警告》

本文为澎湃号作者或机构在澎湃新闻上传并发布,仅代表该作者或机构观点,不代表澎湃新闻的观点或立场,澎湃新闻仅提供信息发布平台。申请澎湃号请用电脑访问http://renzheng.thepaper.cn。

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2024 上海东方报业有限公司